Este post está sendo devido de longa data.

Com a disponibilização da Inteligência Artificial, especialmente Chat GPT, que está colocado gratuitamente na Internet, e a concorrência seguindo o exemplo, veio junto a barulheira de um lado de promessas mirabolantes, de outro a crítica ou o pavor dos intelectuais medíocres ou sabe-se lá que tipo de agenda oculta de outros, quer não sei como adjetivar ou agrupar.

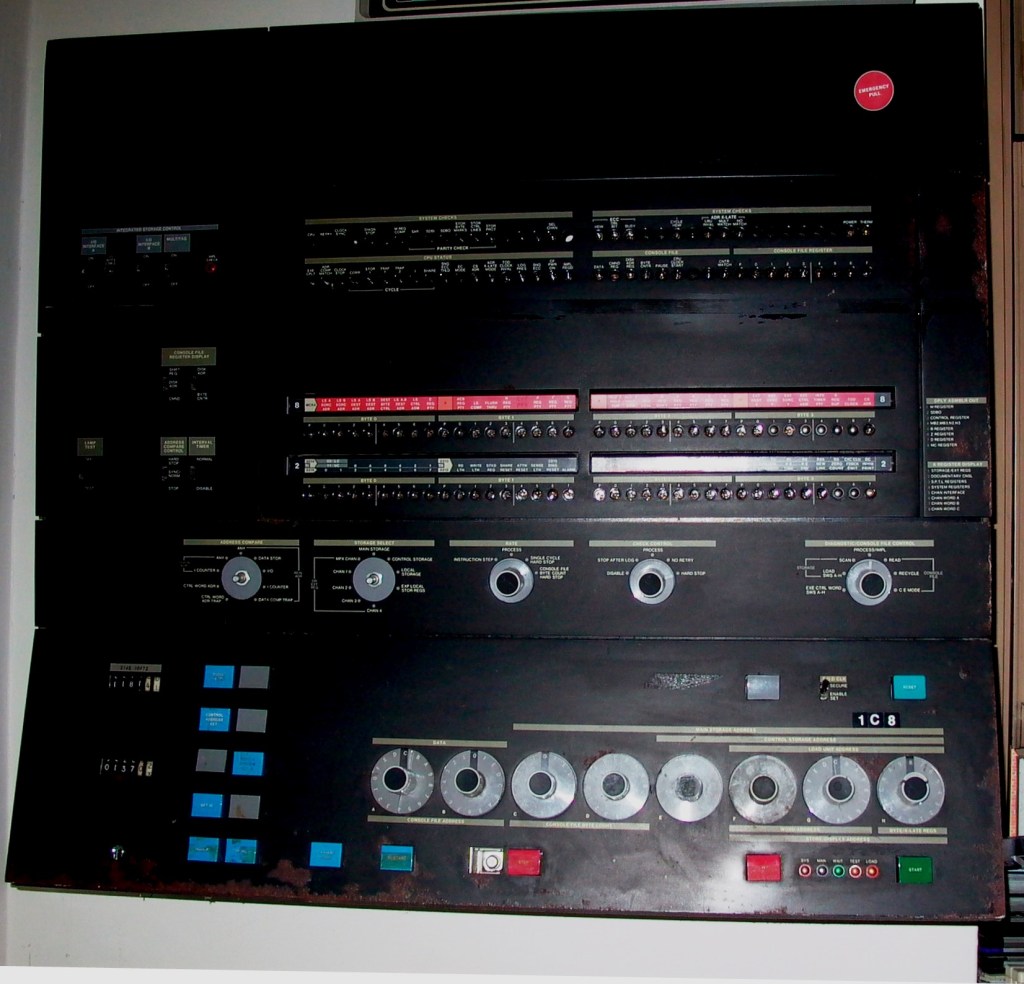

Acho melhor dar uma posicionada, já que meu envolvimento com computadores foi além do convencional, pois ajudei a desenvolver um mainframe na IBM, o 4341, escrevendo diagnósticos para algumas de suas funções, e, para isso, tive que entender como funciona.

Fiz isto na década de 70, a tecnologia estava decolando, e o 4341 foi a primeira máquina de estado sólido que a IBM produziu e ela foi feita com o que é que está por trás da miniaturização que permitiu o aparecimento de máquinas fantásticas que surgiriam, das quais os smartphones, especialmente o Iphone brilha supremo.

Aliás, comparar o poder de processamento de um iPhone moderno com o de um mainframe de tamanho médio como o IBM 4341 é um tanto difícil devido às grandes diferenças em tecnologia e arquitetura. No entanto, em termos de poder e capacidades de computação brutas, um iPhone moderno provavelmente superaria um mainframe de tamanho médio como o IBM 4341 em muitos aspectos.

Vou pegar uma carona na apresentação que o Dr.Michael Wooldridge, Diretor de pesquisa fundamental para Inteligência artificial, do Alan Turing Institute, no UK, de num simpósio que eles fizeram recentemente em 21 de Dezembro de 2023 sobre “O futuro da IA generativa“.

No contexto da inteligência artificial (IA), “generativo” refere-se à capacidade de um modelo ou sistema de criar novos dados, muitas vezes na forma de imagens, texto, áudio ou outros tipos de conteúdo, semelhantes aos exemplos que foi treinado. Os modelos generativos são um tipo de modelo de IA que aprende a gerar novos pontos de dados capturando os padrões subjacentes e a estrutura dos dados de treinamento.

Os modelos discriminativos, em contraste com os modelos generativos, concentram-se na aprendizagem da fronteira entre diferentes classes ou categorias nos dados. Um exemplo de modelo discriminativo é o reconhecimento facial, onde se quer apenas um definição, que corresponde à identidade da imagem facial examinada.

No caso desta imagem estar sendo examinada por um modelo generativo, o que se quer não é aquela pessoa ou algo especifico, mas apenas parecidos com aquela imagem.

A apresentação, além de ser em Inglês, é excessivamente prolixa, e contém pontos que interessam mais aos desenvolvedores de IA (Inteligência Artificial) e separei os pontos que nos interessam para nossos fins aqui é que se máquina consegue pensar como nós.

Neste Post, vou me concentrar em “”Consciousness” (Consciência) & Inteligência Artificial, mas os seguintes tópicos foram discutidos e eu os trato separadamente em posts específicos que podem ser acessados pelos pointers e estão noutro post “Blocos construtivos de Inteligência Artificial“.

Os tópicos tratados nesta palestra de 21 de dezembro de 2023 foram os seguintes:

- Visão Geral Overview -Alan Turing, facial recognition – reconhecimento facial, milestones momentos chave, neural networks redes neurais – Big AI – Transformer Architeture – LLM Large Language Models – GPT3 –Emerging Capabilities

- Aprendizado de Máquina: (Machine Learning) O aprendizado de máquina é um subconjunto de IA que se concentra no desenvolvimento de algoritmos e técnicas que permitem aos computadores aprender com os dados e melhorar seu desempenho em uma tarefa sem serem explicitamente programados. Os algoritmos de aprendizado de máquina podem ser categorizados em aprendizado supervisionado, aprendizado não supervisionado, aprendizado semissupervisionado e aprendizado por reforço, dependendo do tipo de dados de treinamento e dos objetivos de aprendizado.

- Análise de dados: (Data Analytics) A análise de dados envolve o processo de análise de grandes conjuntos de dados para descobrir padrões, tendências e insights que podem informar a tomada de decisões e gerar resultados de negócios. Abrange várias técnicas e métodos para pré-processamento de dados, análise descritiva, análise preditiva e análise prescritiva, com o objetivo de extrair insights acionáveis dos dados.

- Processamento de linguagem natural (Natural Language Processing (NLP)): PLN é um subcampo da IA que se concentra em permitir que os computadores entendam, interpretem e gerem a linguagem humana. Envolve o desenvolvimento de algoritmos e técnicas para tarefas como classificação de texto, análise de sentimentos, reconhecimento de entidade nomeada, tradução automática e resposta a perguntas. As técnicas de PNL geralmente aproveitam abordagens de aprendizado de máquina e aprendizado profundo para processar e analisar dados de texto.

- Large Language Models, (LLM) Grandes modelos de linguagem, como GPT (Generative Pre-trained Transformer) desenvolvidos pela OpenAI, são projetados para executar tarefas de processamento de linguagem natural, como geração de texto, classificação de texto e compreensão de linguagem, com notável proficiência. Esses modelos consistem em milhões ou até bilhões de parâmetros e são treinados usando técnicas como pré-treinamento não supervisionado seguido de ajuste fino em tarefas específicas. (Chat GPT é um upgrade do GPT)

- “Generative” Models modelos “generativos” referem-se à capacidade de um modelo ou sistema de criar novas amostras de dados semelhantes, mas não necessariamente idênticas, aos dados nos quais foi treinado. Os modelos generativos são uma classe de modelos de IA projetados para gerar novas instâncias de dados que se assemelham aos dados de treinamento.

- A “lecture” anterior deste Instituto foi sobre “O que é Inteligência Artificial Generativa e como funciona” , sendo que Chat GPT é o exemplo.

- Issues and Guard Rails – Problemas e sua prevenção – ele está mais preocupado com o aspecto da absorção de lixo da Internet, onde os LLM vão buscar sua referência, que dá origem a êrros e coisas que não batem com os fatos. Discute também algumas situações criminosas, ilegais ou imorais. Acrescenta um tópico interessante que os LLM acabam refletindo a cultura americana e as outras simplesmente não aparecem. Discute Copyright e GDPR (Regulamento Geral de Proteção de Dados) Selfdrive Modelo Tesla

- General Purpose AI – (Inteligência Artificial de Propósito Geral), também conhecida como AGI (Artificial General Intelligence), refere-se a um tipo de inteligência artificial que tem a capacidade de entender, aprender e realizar uma ampla variedade de tarefas de forma semelhante ou mesmo superior à inteligência humana em diversas áreas. Ao contrário da inteligência artificial mais específica, que é projetada para realizar tarefas específicas, como reconhecimento de voz, classificação de imagens ou jogar xadrez, a AGI seria capaz de adaptar-se a novas situações, aprender novas tarefas com facilidade e aplicar seu conhecimento de forma flexível em uma variedade de contextos.

- “Last but not least” – Por último, mas não menos importante, talvez o mais importante, foi abordado Porque computador “não pensa” (embora pareça…)” eu eu separei neste post e se quiser pode ir direto lá se não tiver interesse histórico ou nos detalhes dos blocos construtivos

Esses campos estão interconectados e frequentemente usados em combinação para desenvolver sistemas e aplicativos inteligentes que podem compreender, analisar e interpretar dados em diversas formas, incluindo texto, imagens, áudio e muito mais. Eles têm aplicações em uma ampla variedade de domínios, incluindo saúde, finanças, comércio eletrônico, atendimento ao cliente e muito mais, e desempenham um papel crucial no avanço dos recursos da tecnologia de IA.

Algumas considerações iniciais antes de atacar o que interessa

A IBM oficialmente tinha ressalvas quanto a computadores tipo mainframes que ela iria criar e massificar.

Em 1948, o presidente da IBM, Thomas J. Watson, supostamente disse: “Acredito que haja um mercado mundial para talvez cinco computadores.” No entanto, não há evidências definitivas de que ele realmente tenha feito essa declaração. Ele tinha muito receio de substituir as tabuladoras baseadas nos cartões perfurados por qualquer outra coisa. Antes do surgimento dos computadores modernos, as máquinas que desempenhavam funções semelhantes ao que os computadores modernos fazem eram geralmente dispositivos mecânicos ou eletromecânicos projetados para realizar cálculos ou processar informações de maneira específica.

É uma história um pouco longa como Thomas Watson acabou patrocinando com recursos e peças a construção do primeiro computador eletromecânico, feito com peças de tabuladoras da IBM, que foi o IBM Automatic Sequence Controlled Calculator (ASCC), também conhecido como Harvard Mark I. Este computador foi desenvolvido em conjunto pela IBM e pela Universidade Harvard durante a Segunda Guerra Mundial e foi concluído em 1944.

O Harvard Mark I foi projetado para realizar cálculos matemáticos complexos, como tabelas de artilharia e trajetórias de projéteis, que eram essenciais para os esforços de guerra. Era composto principalmente por peças de tabuladores IBM, dispositivos eletromecânicos que foram adaptados e modificados para realizar operações computacionais.

Além disso, em 1956, a IBM fez uma declaração oficial em resposta ao relatório da Conferência de Dartmouth , que foi um evento importante no desenvolvimento da inteligência artificial. A posição oficial da IBM na época era que a inteligência artificial era um importante campo de pesquisa, mas a empresa não acreditava que as máquinas pudessem alcançar o verdadeiro pensamento ou consciência.

O 4341, com o qual estive envolvido, foi desenvolvido em Endicott, NY, onde a IBM nasceu e é o lugar que mais fabricou mainframes no mundo.

Uma das práticas desse laboratório eram reuniões mensais no restaurante para discussões abertas sobre tecnologia, arquitetura, mainframes, o que fosse.

Nos quatro anos que passei lá nunca vi uma discussão sobre a possibilidade de as máquinas pensarem. ou Inteligência Artificial. Todos que trabalharam lá sabiam e sabem que máquinas não conseguem pensar…

Parece que essa postura de alguma forma impediu a IBM de ter algo como o Chat GPT no mundo moderno. Talvez tenha sido uma estratégia mal definida e com recursos e competência insuficientes, não sei.

A IBM, porém, tinha a imagem e a possibilidade de ocupar esse espaço, principalmente considerando dois acontecimentos que tiveram muita exposição pública:

O primeiro foi a criação de um programa que acabou vencendo um grande campeão de xadrez, Kasparov, chamado Deep Blue .

A segunda foi a criação do Watson , que foi inicialmente desenvolvido para responder perguntas do popular programa de perguntas e respostas Jeopardy! e em 2011, ficou famoso contra os campeões Brad Rutter e Ken Jennings, ganhando o prêmio de primeiro lugar de 1 milhão de dólares.

O Watson se parece um pouco com o Chat GPT e tem uma arquitetura semelhante, mas voltado para empresas e não para uso doméstico e foi testado principalmente para saúde.

A IBM não chegou a uma conclusão geral de que a sua plataforma Watson não consegue diagnosticar problemas de saúde de forma confiável. No entanto, tem havido desafios e críticas relacionadas com implementações específicas do Watson no setor da saúde.

Após o sucesso inicial do Jeopardy, a IBM decidiu usar o Watson em programas de saúde; no entanto, o Watson for Oncology da IBM, por exemplo, enfrentou um escrutínio devido a preocupações sobre a precisão e a confiabilidade de suas recomendações de tratamento do câncer. Alguns relatórios sugeriram que o Watson for Oncology forneceu recomendações que eram inconsistentes com as diretrizes médicas estabelecidas ou que não possuíam evidências clínicas suficientes para apoiar seu uso. Estas preocupações levantaram questões sobre a confiabilidade e eficácia dos sistemas de apoio à decisão clínica orientados pela IA nos cuidados de saúde.

A IBM vendeu o Watson com prejuízo e o programa agora se chama Merative.

Antes de entrar no nosso assunto, algumas considerações.

Computadores Pessoais (PC’s)

Vale a pena ver, pois são os canais que a Inteligência Artificial é acessada.

Nesses encontros do restaurante em Endicott, que mencionei antes e onde trablahei ajudando a criar o 4341, a preocupação maior que surgia constantemente era a possibilidade de uma máquina que pudesse ser doméstica, como seria o PC, que já estava pensado desde o início dos anos 70. O conceito de um computador pessoal (Personal Computer, PC) começou a surgir na década de 1970, com o desenvolvimento de computadores menores e mais acessíveis destinados ao uso individual. Recordar é viver e as máquinas iniciais que existiam com finalidade doméstica eram:

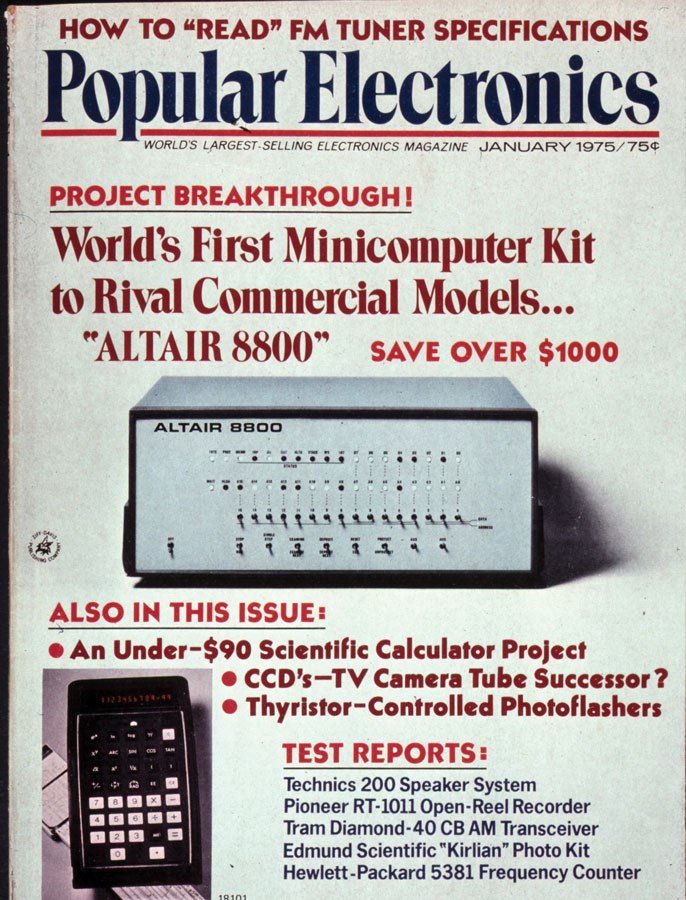

- Altair 8800 (1975): O Altair 8800, fabricado pela MITS, foi um dos primeiros computadores pessoais disponíveis comercialmente. Ele era vendido como um kit que os usuários montavam e programavam por conta própria.

- Commodore 64 (1982): O Commodore 64 foi um dos computadores pessoais mais populares da década de 1980. Ele era acessível e oferecia recursos avançados para a época, como gráficos coloridos e som avançado.

- TRS 80 e Tandy 1000 da Radio Shack

O Altair custava uns 400 dólares e o Commodore uns 600. O TRS 80 começou com 600, acabou com mais de 1000 e o Tandy passou de 1000. Naquela época, eu comprei um Camaro com dois anos de uso em excelente estado por 1500 dólares. Meu pai foi nos visitar e para nosso horror comprou um Commodore para meu sobrinho que depois iria fazer Engenharia de Computação na USP uns 10 anos depois, mas é outra história.

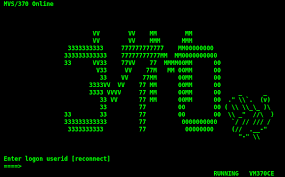

Na IBM a arquitetura do 360/370 incorporou o VM, Virtual machine e o teleprocessamento, que permite voce ter num terminal 3270 (que era totalmente sem inteligência) um mainframe e todos usavam as impressoras, armazenamento, etc, compartilhados em algum CPD (Centro de Processamento de Dados).

O VM era essencialmente o que a Internet e a Cloud Computing é hoje e não dá para entender como a IBM deixou isso escapar…

Todos os locais IBM no mundo inteiro que tinham alguma expressão eram interligados por satélites e aqui no Brasil, em 1970 a gente conseguia falar com o mundo inteiro onde tivesse alguma IBM.

Era tudo ligado por satélites e canais de voz que a IBM alugava onde estivesse.

Lá em Endicott, várias vezes, nestas reuniões no restaurante, as pessoas interessadas em computadores pessoais pensavam em criar máquinas domésticas com a arquitetura do VM e sempre esbarravam em dois problemas básicos: o tamanho, que era impraticável, e o custo, que era três ou quatro vezes o custo de um carro normal Ford ou Chevrolet da época… (nos Estados Unidos…)

Sem mencionar, que o VM era “text based”, isto é, não tinha imagem e você interagia através de frases ou textos.

Bill Gates já engatinhava com o Windows que utiliza uma interface gráfica de usuário (GUI), que é baseada em elementos visuais, como ícones, menus, janelas e botões, em vez de depender exclusivamente de texto. Isso significa que os usuários podem interagir com o sistema operacional de forma mais intuitiva e visual, clicando em ícones e menus em vez de digitar comandos de texto.

Para encurtar a história e evidenciar o que significa isto: para manejar o VM voce tinha um treinamento que levava uns 6 meses para ficar esperto.

No Windows, em uma semana você domina tudo…

Como a inteligência dos consoles de Mainframes atingiram os Personal Computers

O aumento da complexidade e tamanho dos Mainframes criou a necessidade de solução para o que iria ser posteriormente conhecido nos computadores pessoais como “BIOS” (Basic Input/Output System) que foi introduzido mais tarde, em meados da década de 1970. O BIOS originalmente era um conjunto de instruções de baixo nível armazenadas em um chip de memória ROM (Read-Only Memory) que controlava as operações básicas de entrada e saída de um computador, como inicialização, configuração de hardware e comunicação com dispositivos periféricos. Os mainframes normalmente não possuem um BIOS (Basic Input/Output System) tradicional como os computadores pessoais. Em vez disso, os mainframes geralmente usam um tipo diferente de firmware ou processo de inicialização para inicializar e configurar componentes de hardware durante a inicialização do sistema. No 4341 as funções do que é o BIOS para um PC era gerenciado por um micro probessador que transformava em mensagens as informações geradas dentro da máquina, especialmente quando se tratava de mau funcionamento.

Para funcionar este “BIOS” dos mainframes, a INTEL criou um processador talvez de 2 bits, que fazia a interface entre a máquina e o terminal visual do operador.

A empresa de Bill Gates foi contratada para desenhar este interface e percebeu que era um mini mini computador e se propôs a criar uma máquina com ela e foi prontamente rejeitado pela IBM.

A IBM acabou cedendo e os microprocessadores evoluíram um pouco mais e acabou que a IBM desenhou um Sistema Operacional completo para o PC que ela lançou e Bill Gates foi profundamente envolvido neste processo, com a diferença, acreditem se quiserem, que a primeira vez que a IBM abriu uma arquitetura para uso geral foi aí…

Esse processador começou como um computador de 4 bits, passando para 8 e 16 bits, terminando nas máquinas de 32 e 64 bits de hoje e excepcionalmente 128. Esses pequenos processadores precisavam de um sistema operacional e software para fazer o que tinham que fazer, que era interpretar o Mainframe em inglês suas mensagens hexadecimais o operador ou para o técnico no caso de conserto.

A empresa terceirizada contratada para fazer isso foi liderada por Bill Gates. Esses pequenos “motores” levaram à criação dos computadores domésticos. Antes do lançamento do IBM PC, o mercado de computadores domésticos era dominado por sistemas que usavam os microprocessadores 6502 e o Z80 de 8-bits como o TRS 80, Commodore PET e o Apple II series, que usavam sistemas operacionais proprios por computadores executando CP/M. Depois que a IBM introduziu o IBM PC, em1984, clones do IBM PC se tornaram dominantes como computadores domésticos. Isto é explorado com mais detalhes em The Missing Link 1975 2016 Personal Computers.

Porque computador “não pensa” (embora pareça…)

O computador “não pensa” no sentido de que não tem o que em Inglês é definido como “consciousness” que traduzido é consciência, porém “conscience” em Inglês é outra coisa.

“Consciousness” geralmente se refere ao estado de estar ciente e ser capaz de perceber o que está ao seu redor, pensamentos, sensações e sentimentos. É sobre estar acordado e experimentar o mundo.

“Conscience”, por outro lado, normalmente se refere ao sentido interno do que é certo ou errado na conduta ou nos motivos de alguém, muitas vezes orientando suas ações e decisões. Envolve julgamento moral e considerações éticas.

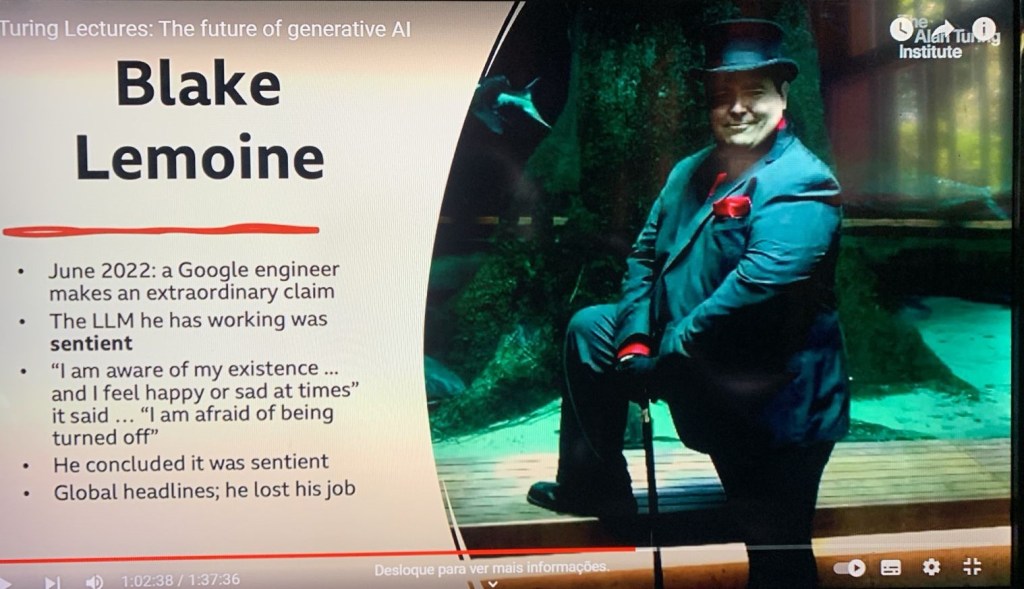

Consciousness pode ser discutido sob diversos prismas, mas vamos procurar nos ater aos que efetivamente podem ser conectados com Inteligência Artificial e neste sentido, o Dr.Michael Wooldridge apresentou os seguintes slides que nos levam diretamente ao ponto em questão:

Dr. Michael usou neste slide “sentient” como sinônimo de “consciousness”, talvez não intencionalmente, apenas declarando que este artista aí da foto não somente foi imediatamente despedido, como gerou uma comoção enorme diante do que ele declarou como tendo acontecido, o que Dr. Michael declarou que ele estava equivocado ou “errou” em tantas e tão variadas instâncias, que não dava nem para começar a crítica, embora, na sequência, ele enumerou uma lista de impedimentos que eu vou transcrever. Antes disso, algumas observações:

Diferença entre “sentient” e “consciousness”:

“Sentient” (Sentientes, sensíveis, conscientes no sentido de perceber) Senciente refere-se à capacidade de perceber sensações ou experimentar sentimentos, como dor, prazer, fome, calor e assim por diante. Uma entidade senciente é capaz de experimentar estados subjetivos e responder a estímulos em seu ambiente. A senciência é frequentemente associada à capacidade de vivenciar emoções e ter experiências sensoriais.

“Consciousness” Consciência: A consciência é um conceito mais amplo e complexo do que a senciência. Abrange o estado de estar consciente e ser capaz de perceber o que está ao seu redor, pensamentos, sensações e sentimentos. A consciência envolve autoconsciência, introspecção e a capacidade de refletir sobre os próprios estados mentais. Inclui a capacidade para experiências subjetivas, processos cognitivos e funções mentais de ordem superior.

Os animais são sentientes mas não atingem a “consciousness” dos humanos e a tem de forma muito limitada.

Inteligência Artificial não é nem sentiente nem tem consciência no sentido de consciousness acima.

O exemplo que Dr. Michael dá é que se você estiver usando o Chat GPT, que parece ser a plataforma de IA mais bem sucedida neste momento (2024) e voce interromper uma interação e voltar depois de uma semana, o Chat GPT vai continuar como se nada tivesse acontecido e não vai questionar onde você foi ou porque sumiu.

Ele aponta uma coisa interessante neste aspecto que esclarece porque a Ciência não consegue satisfazer questões que a Religião, por exemplo, não responde com objetividade, mas com aspectos de “consciousness” que são nossa marca registrada.

Ou seja, o Chat GPT é construído objetivamente e se limita ao que está objetivametne na sua frente e não tem subjetividade ou estabelece conexões que são um privilégio de uma carateristica de nossa mente que ele não tem, que são os atributos ligados à “consciousness”.

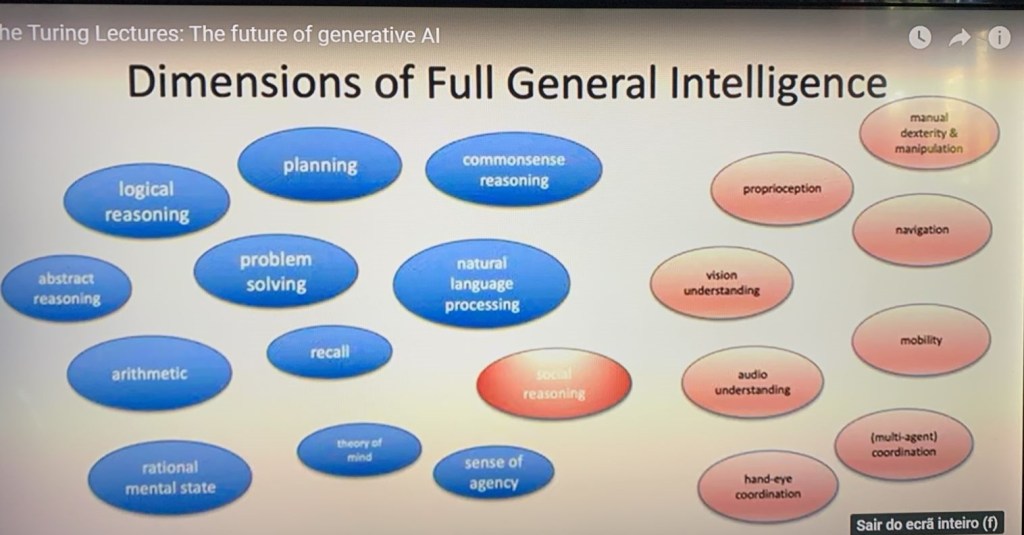

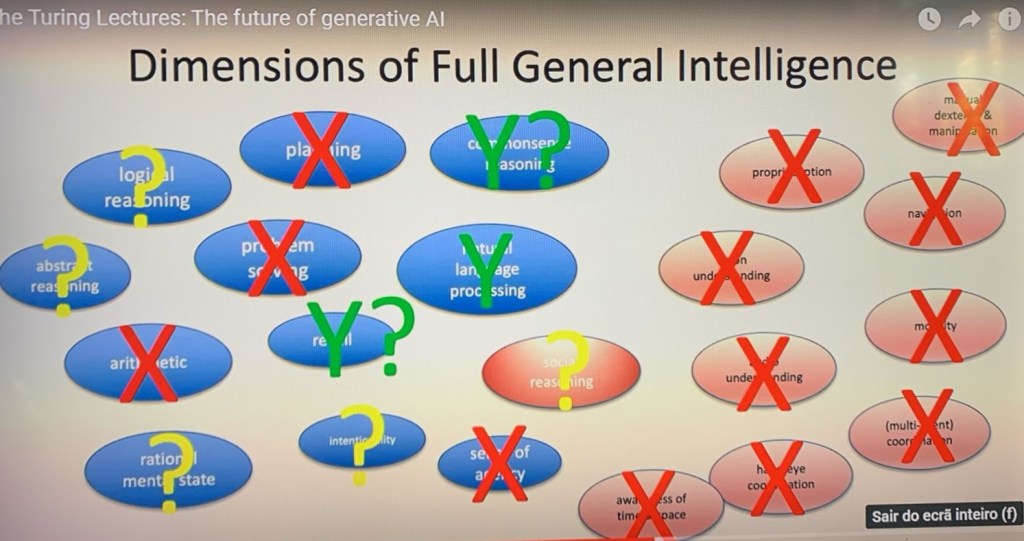

Como já disse, dependendo do prisma sob o qual você analisa, estes atributos variam, porém ele particularizou os seguintes para os quais ele faz um breve balanço de como a Inteligência Artificial está conseguindo ou não atingir.

Transcrevo aqui as palavras ipsis litteris com as quais o Prof. Michael encerra esta discussão:

“Você está no meio de uma conversa com o Chat GPT e sai de férias por algumas semanas. Quando você volta, o Chat GPT está exatamente no mesmo lugar. O cursor está piscando, esperando que você digite seu a próxima coisa. Ele não estava se perguntando onde você estava. Eu não estava ficando entediado. Ele não estava pensando: ‘para onde diabos Wooldridge foi?’ – você sabe – ‘Não vou mais conversar com ele.’ Não está pensando absolutamente nada. É um programa de computador, que está girando em um link que está apenas esperando que você digite a próxima coisa. Agora não existe uma definição sensata de senciência, eu acho, que admita isso. como sendo senciente. Absolutamente não é senciente. Então, acho que ele (Blake Lemoine) estava muito, muito errado, mas (de qualquer forma) conversei com muitas pessoas posteriormente que conversaram com o Chat GPT e outros modelos de linguagem grande. e eles voltam para mim e dizem: ‘você tem certeza mesmo?’ Porque na verdade é realmente impressionante. Sinto que há uma mente por trás da cena. Então, vamos falar sobre isso e acho que temos que responder a elas.

Ele chama de dimensões, este atributos: (Em azul o que fazemos dentro de nossas mentes e em vermelho o que fazemos no mundo físico)

O que disso a Inteligência Artificial está conseguindo emular, ou simular? O que está em verde e se tem um ponto de interrogação, é atingido parcialmente. Observe-se que os balões não são totalmente equivalentes nos dois slides. No primeiro, nos balões azuis, onde se lê a dimensão “teoria da mente), no segundo aparece “intencionalidade”. Nos vermelhos, estão dimensões que a Inteligência Artificial não tem nada ainda. Onde aparece “coordenação das mãos e os olhos”, no segundo aparece “percepção de tempo e espaço”. Acho que ele usa estes slides para outras finalidades.

Os pontos de interrogação em amarelo são para dimensões que existe alguma coisa, mas não resolve totalmente.

A única coisa que ele considera que Inteligência Artificial consegue fazer bem é o processamento da linguagem natural, embora isto seja sujeito a controvérsias, que ele discute em separado e que vou apresentar como detalhe mais para quem está interessado no ângulo da programação. O que está em vermelho são coisas que são uma combinação do pensamento com a habilidade manual ou física de implementar na realidade, como por exemplo atividades de marcenaria, que ele chama de destreza manual ou de manipulação no sentido de usar as mãos em conjunto com habilidades que um profissional de trabalhos manuais tem.

Logicamente os balões vermelhos requerem robótica, que ele observa que está muito longe de atingir equivalência com os humanos, porque simplesmente é muito mais difícil.

Mas afinal o que é esta característica humana que a Inteligência Artificial não consegue emular?

É a consciência, no sentido que em inglês se diz “Consciousness”

- Conscience: É o seu “juiz interno”. É o que te faz sentir culpa ou paz de espírito com base no que você acredita ser certo ou errado.

- Consciousness: É apenas o fato de você estar acordado ou ciente de que existe (sentido biológico/físico).

Não se sabe o que é…

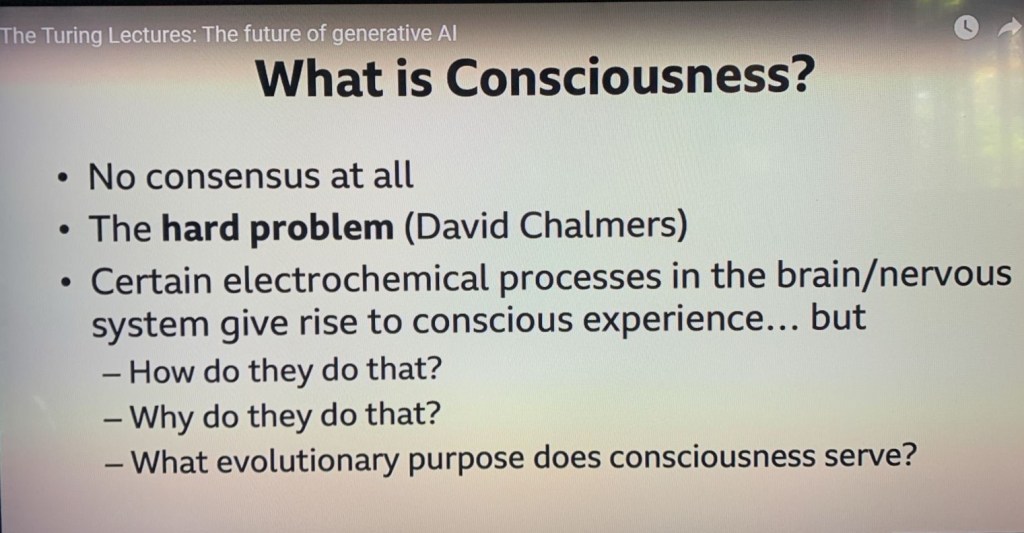

Porém existe uma percepção filosófica que se encaixa bem no que ele chama de “hard problem” e que ele define como “certos processos eletroquímicos no cérebro/sistema nervoso que dão origem à experiência de consciência.. porém

- Como isto ocorre?

- Porque ocorre?

- A que propósito evolutivo serve a consciência?

Nós não sabemos e não entendemos nada como isto ocorre… Isto é chamado “the hard problem” – problema dificil – da ciência cognitiva. Este “hard problem” é que existem certos processos eletricos e quimicos no cérebro e o sistema nervoso, e podemos ver estes processos eletroquimicos, podemos ve-los operando e de alguma forma eles de alguma forma dão origem à experiência da consciência, mas, porque eles fazem isto, como eles fazem isto, para qual finalidade evolutiva isto serve, honestamente, não temos a menor ideia. Existe uma desconexão enorme entre o que vemos operando no cérebro fisico e nossa experiencia de consciência ou a nossa rica e privativa vida mental. Desta forma, não existe compreensão disto em nenhuma forma, penso, a proposito,

Mais algumas obervações antes de prosseguir: (expandindo um pouco o que ele apresentou)

Curiosamente, esta forma que êle esta usando para se aproximar da questão, foi a usada por dois importantes pensadores, Renée Descartes e John Locke. Descartes, com seu “penso, logo sou” – cogito, ergo sum – definiu a própria noção de pensamento (pensée) em termos de consciência reflexiva ou autoconsciência. Na sua obra “Princípios de Filosofia” (1640) ele escreveu: (Stanford Encyclopedia of Philosphy – “Consciousness)

Pela palavra “pensamento” (“pensée”) entendo tudo aquilo de que temos consciência operando em nós.

Mais tarde, no final do século XVII, John Locke apresentou uma afirmação semelhante, embora um pouco mais qualificada, em “An Essay on Human Understanding” (1688):

Não digo que não haja alma no homem porque ele não tem consciência disso durante o sono. Mas eu digo que ele não consegue pensar em nenhum momento, acordado ou dormindo, sem ter consciência disso. Sermos sensíveis a isso não é necessário para nada além de nossos pensamentos, e para eles é e para eles sempre será necessário.

No início da psicologia científica moderna, em meados do século XIX, a mente ainda era amplamente equiparada à consciência, e os métodos introspectivos dominavam o campo, como nos trabalhos de Wilhelm Wundt (1897), Hermann von Helmholtz (1897), William James ( 1890) e Alfred Titchener (1901). No entanto, a relação da consciência com o cérebro permaneceu um mistério, conforme expresso na famosa observação de T. H. Huxley:

Como é que algo tão notável como um estado de consciência surge como resultado de irritação do tecido nervoso é tão inexplicável quanto o aparecimento do Djin, quando Aladdin esfregou sua lâmpada (1866).

Que é o que Dr. Michael colocou em seu slide, mais de 150 anos depois…

Dr. Michael, porém, nos traz o pensamento do filósofo Thomas Nagel, que nos permite perceber o que está em jogo na questão da Inteligência Artificial e o desafio de alguma senciência nos moldes da “consciousness” humana.

Vou citar e sumarizar, transcrevendo um artigo da Atlantis, “Bringing Mind to Matter“onde é discutido Thomas Nagel e David Chalmers aparece com mais detalhe:

O filósofo americano Thomas Nagel foi responsável por duas das contribuições mais importantes para a filosofia da mente no século XX. Ambos tornaram mais difícil a compreensão de como as mentes se encaixam em um universo esmagadoramente estúpido.

A primeira foi num famoso artigo de 1974 que fazia a pergunta: “Como é ser um morcego?” Nagel salientou que a maioria dos filósofos da mente tinha de alguma forma, inexplicavelmente, ignorado as características definidoras das mentes: nomeadamente, que elas são conscientes, vivendo num mundo de sensações sentidas. O artigo de Nagel ajudou a trazer para a corrente dominante a ideia de que um organismo só é consciente se “existe algo como ser esse organismo” – isto é, se a criatura tiver a sua própria experiência do mundo. Embora não faça sentido dizer que ser uma pedra é como algo, é perfeitamente óbvio que ser humano – pelo menos, um ser humano específico num momento específico – é como algo, na verdade, como muitas coisas.

Esta diferença entre a experiência de uma pessoa e a não-experiência de uma pedra não pode ser captada pela soma total do conhecimento objetivo que podemos ter sobre a constituição física dos seres humanos e das pedras. A experiência consciente, por mais subjetiva que seja para o organismo individual, está além do alcance de tal conhecimento. Eu poderia saber tudo o que há para saber sobre um morcego e ainda não saber o que é ser um morcego – ter as experiências de um morcego e viver a vida de um morcego no mundo de um morcego.

Esta afirmação foi longamente discutida por uma miríade de filósofos, que mobilizaram uma série de experiências mentais para investigar a afirmação de Nagel. Entre as mais famosas está o ensaio sobre uma supercientista fictícia chamada Mary, que estuda o mundo a partir de uma sala contendo apenas as cores preto e branco, mas tem conhecimento completo da mecânica da óptica, da radiação eletromagnética e do funcionamento do sistema visual humano. Quando Mary finalmente é libertada da sala, ela começa a ver cores pela primeira vez. Ela agora sabe não apenas como os diferentes comprimentos de onda da luz afetam o sistema visual, mas também a experiência direta de como é ver as cores. Portanto, as experiências e sensações sentidas são mais do que os processos físicos que lhes estão subjacentes.

(abro um parêntesis porque fica claro o problema que a ciência tem ao descrever o mundo ao máximo eliminando o ponto de vista do observador e porque a ciência não pode substituir outras formas humanas de perceber a realidade, como a religião, por exemplo, como já citei)

Alguns filósofos aceitaram esta conclusão, mas argumentaram que Mary não teria conhecimento adicional. Mas este é realmente o ponto de vista de Nagel: as novas experiências que Mary tem são fundamentalmente diferentes do conhecimento objetivo. (eu acrescentaria: científico) Esta conclusão está intimamente ligada a outra (e segunda) contribuição fundamental de Nagel para a filosofia da mente:

a observação de que a visão de primeira pessoa do sujeito que percebe é incomensurável com a visão objetiva de terceira pessoa da ciência física.

Uma é uma “visão daqui” – o que quer que seja aqui para um sujeito que experimenta – enquanto a outra aspira ser tão livre dos preconceitos da subjetividade que se torna uma “visão do nada”.

Nagel explorou esse tema no livro de 1986 que construiu sua reputação internacional. The View from Nowhere (Visão do nada) onde ele argumenta não apenas que a visão subjetiva da nossa percepção não pode ser reduzida à visão objetiva do universo, mas, mais importante ainda, que, ao contrário do que tanto o pensamento científico moderno tenta mostrar, a visão objetiva não pode substituir ou eliminar com a visão subjetiva.

Que destroi de vez a idéia da visão objetiva de terceira pessoa da ciência física.

O fato de não existir “eu”, “aqui” ou “agora” na perspectiva científica não mostra que estas coisas sejam irreais, mas antes que a ciência física é, e poderá sempre permanecer, incompleta. Da mesma forma, embora a física pretenda reduzir e marginalizar as chamadas qualidades “secundárias”, como cor e brilho, ao que (presunçosamente) chama de qualidades “primárias”, como comprimento de onda e amplitude da luz, isso não prova que as cores sejam menos reais do que ondas eletromagnéticas; apenas mostra que a ciência puramente objetiva tem limitações. Como as qualidades secundárias são a própria matéria da consciência, a experiência permanecerá sempre fora do alcance total da ciência. A ciência objectiva, em suma, não consegue captar o que é ser um sujeito que inevitavelmente experiencia o mundo a partir de um determinado ponto de vista.

Nagel ainda explorou mais o assunto num livro que ele publicou, “Mind an Cosmos“, que o artigo da Atlantis cita e eu sumarizo:

“Mind and Cosmos”, de Thomas Nagel, critica a afirmação da ciência objetiva de explicar a consciência e o lugar da mente no universo. Nagel argumenta que a visão de mundo da ciência moderna, que postula uma relação hierárquica entre as disciplinas de biologia, química e física e busca uma explicação unificada para tudo no universo, não consegue acomodar características-chave da mente, como consciência, cognição e valor. .

Nagel desafia a suposição de que a mente pode ser reduzida a eventos físicos no cérebro ou explicada apenas por processos evolutivos. Ele argumenta que o problema mente-corpo se estende além da relação entre mente, cérebro e comportamento nos organismos vivos para invadir nossa compreensão de todo o cosmos. Ele sugere que a consciência pode ter estado presente desde o início e explora as implicações do panpsiquismo, a teoria de que toda coisa física tem qualidades mentais.

Nagel questiona se a seleção natural pode explicar o surgimento de organismos complexos e conscientes e desafia as teorias reducionistas da consciência e da vida. Ele propõe uma hipótese teleológica para a existência de vida, mente e valor, sugerindo que a vida existe porque é uma condição necessária de valor.

Este livro de Nagel desafia os pressupostos do naturalismo científico e explora perspectivas alternativas sobre a natureza da consciência, da cognição e do valor no universo.

No artigo, David Chalmers é mencionado como exemplo de filósofo que examinou a questão da consciência e sua relação com eventos físicos no cérebro. Chalmers é descrito como um dos “filósofos de mente mais aberta” que explorou os argumentos contra a redução da mente ao cérebro.

Embora o artigo não se aprofunde nas contribuições específicas de Chalmers, sugere que o seu trabalho tem sido influente no desafio da suposição de que a consciência pode ser compreendida puramente em termos de eventos neurais. Chalmers é conhecido por sua formulação do “difícil problema da consciência”, (The Hard Problem no slide do Dr. Michael Woolbridge) que destaca o desafio de explicar a experiência subjetiva e os aspectos qualitativos da consciência em termos puramente físicos.

Ao mencionar Chalmers, o artigo sugere que mesmo os filósofos que estão dispostos a explorar perspectivas alternativas sobre a consciência reconhecem as limitações das teorias puramente reducionistas. O trabalho de Chalmers contribuiu para o debate contínuo sobre a natureza da consciência e sua relação com o mundo físico.

“Hard Problem” (Problema Dificil)

No contexto da filosofia da mente e dos estudos da consciência, o termo “Hard Problem” (problema difícil) refere-se ao desafio de explicar experiências subjetivas, ou qualia, em termos de processos físicos. Foi criado pelo filósofo David Chalmers em seu artigo “Facing Up to the Problem of Consciousness” (1995).

O “problema difícil” surge da observação de que a ciência física, como a neurociência e a psicologia cognitiva, pode explicar muitos aspectos da consciência, como o comportamento e as funções cognitivas, através do estudo da atividade cerebral e dos processos neurais. No entanto, estas abordagens normalmente têm dificuldade em explicar porque é que certos processos físicos dão origem a experiências subjectivas – como é ver a cor vermelha, sentir dor ou sentir alegria.

Por outras palavras, embora a ciência possa explicar como o cérebro processa a informação visual ou responde a estímulos, ela tem dificuldade em explicar porque é que estes processos são acompanhados por experiências subjectivas. Este aspecto da consciência – o subjetivo “como é” ter uma experiência – é considerado o “problema difícil” porque parece difícil de capturar ou explicar apenas dentro da estrutura da ciência física.

O difícil problema destaca uma lacuna na nossa compreensão atual da consciência e levanta profundas questões filosóficas sobre a relação entre o mundo físico e a experiência subjetiva. Provocou debates e discussões entre filósofos, cientistas e investigadores que procuram aprofundar a nossa compreensão da consciência.

Qualia

Muitas definições de qualia foram propostas. Uma das definições mais simples e mais amplas é: “O caráter ‘como é’ dos estados mentais. A sensação de ter estados mentais como dor, ver vermelho, cheirar uma rosa, etc.”

Em literatura tem uma particularização interessante sobre qualia. Os escritores definem, ou sentem, qualia, como sentimentos naturais ou não processados e inexplicáveis e nossa incapacidade de descrevê-los e constituem uma lacuna que falta explicação (explanatory Gap). Ambos os conceitos, desde a solidão dos nossos sentimentos individuais até às inadequações da linguagem, são partes da condição humana que existem e não dão sinais que vão desaparecer tão cedo.

No artigo acima, é discutido o conceito de qualia e a lacuna explicativa, (explanatory gap) tendo como exemplo a experiência subjetiva da percepção das cores. Qualia refere-se a sentimentos ou experiências sensoriais cruas e inexplicáveis que ocorrem inteiramente em nossas mentes. A lacuna explicativa refere-se à nossa incapacidade de descrever essas experiências de forma adequada, apesar da complexidade da linguagem humana.

O autor reflete sobre como os humanos possuem uma “teoria da mente“, ou funcionamento da mente, que nos permite reconhecer e investigar as experiências subjetivas dos outros. Esta característica distingue os humanos de outros animais e contribui para a nossa capacidade de compreender as perspectivas uns dos outros.

O artigo explora então o papel da escrita para preencher a lacuna explicativa. Seja por meio de romances, textos de não ficção ou artigos persuasivos, os escritores se esforçam para transmitir ideias, emoções e conhecimentos da forma mais clara possível. Ao usar uma linguagem descritiva e elaborar argumentos convincentes, os escritores pretendem se conectar com os leitores e melhorar o entendimento mútuo.

O artigo enfatiza a importância da conexão e da compreensão humanas, destacando o papel da escrita na facilitação da comunicação e na colimação de lacunas na experiência subjetiva.

(A colimação é o processo de alinhamento óptico de um instrumento, como uma câmera, um telescópio ou um microscópio, para garantir que a imagem esteja focada corretamente.)

Explanatory Gap – Lacuna Explicativa

Na literatura e na filosofia da mente, o termo “lacuna explicativa” (explanatory Gap) refere-se à dificuldade ou incapacidade percebida de explicar completamente experiências subjetivas, como a consciência, por meio de métodos científicos objetivos ou explicações físicas. Este conceito destaca o desafio de colmatar (paralelizar) a divisão entre os processos físicos objetivos do cérebro e a natureza subjetiva e qualitativa das experiências conscientes.

A lacuna explicativa surge da observação de que, embora os métodos científicos tenham sido bem sucedidos na compreensão e explicação de muitos aspectos do mundo natural, parecem ser insuficientes quando se trata de fornecer uma descrição completa das experiências subjetivas. Por exemplo, a investigação neurocientífica pode identificar correlatos neurais da consciência ou da atividade cerebral associados a certos estados mentais, mas muitas vezes tem dificuldade em explicar como é que estes processos físicos dão origem aos aspectos ricos e qualitativos da experiência consciente, tais como a sensação de dor, a percepção da cor ou o sentimento de amor.

Os filósofos da mente e os cientistas cognitivos têm lutado com a lacuna explicativa durante décadas, explorando várias teorias e abordagens para compreender a relação entre o cérebro e a consciência. Alguns argumentam que a lacuna explicativa reflete as limitações dos métodos científicos atuais e que os avanços futuros poderão eventualmente colmatar (alinhar uma com a outra) a divisão. Outros sugerem que a consciência pode exigir conceitos fundamentalmente novos ou estruturas explicativas que vão além do âmbito da compreensão científica atual.

A lacuna explicativa é um desafio central no estudo da consciência e do problema mente-corpo, destacando a complexidade da compreensão das experiências subjetivas no âmbito da ciência objetiva. A ciência busca, na medida do possível, eliminar pontos de vista subjetivos e/ou tendenciosos em favor de uma abordagem objetiva e imparcial. A ciência se baseia em princípios de racionalidade, evidência empírica e metodologia sistemática para investigar e compreender os fenômenos naturais e o mundo ao nosso redor. Idealmente, para ser ciência mesmo, tem que eliminar o conteúdo que foi definido anteriormente como “explanatory gap” ou lacuna explicativa. Evidentemente todo o aparato dito como “científico” não tem como cientificamente definir os conteúdos dos “explanatory gaps”, porém, os seres humanos continuam sentindo e percebendo isto e a reconciliação destes dois opostos por enquanto, é um “hard problem” -problema difícil sem solução. Não consigo evitar de observar, mas quem pretende que as coisas possam ser todas definidas cientificamente, parecem avestruzes com a cabeça enfiada no chão…

Conclusão

Cito ipsis litteris Dr Michael Wooldridge:

“A propósito, acho que meu melhor palpite sobre como a consciência será resolvida, se é que será resolvida, é através da abordagem evolutiva, mas uma ideia geral é que a experiência subjetiva é central para isso, que é a capacidade de experimentar as coisas de um ponto de vista e perspectiva pessoal. Há um teste famoso atribuido a Nagle, que é responder à pergunta: ‘O que é ser alguma coisa?” e Thomas Nagel, na década de 1970, disse que “algo é consciente se é algo ser aquela coisa”. Não é nada parecido com ser ChatGPT. ChatGPT não tem vida mental alguma. Nunca experimentou nada no mundo real. E por essa razão, e por uma série de outras que não teremos tempo de abordar – só por essa razão, penso que podemos concluir com bastante segurança que a tecnologia que temos agora não é consciente. E, na verdade, essa não é absolutamente a maneira correta de pensar sobre isso. E, honestamente, na IA, não sabemos como lidar com máquinas conscientes. Mas não sei por que faríamos isso?”